一个让物理学家狂喜的AI工具,在GitHub上开源了!

它名叫Φ-SO ,能直接从数据中找到隐藏的规律,而且一步到位,直接给出对应公式。

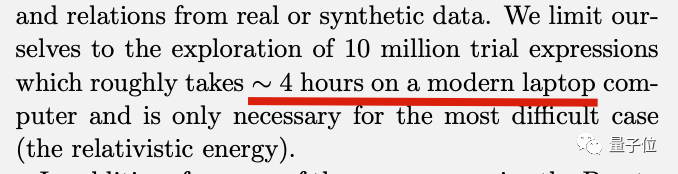

整个过程也不需要动用超算,一台笔记本大概4个小时就能搞定爱因斯坦的质能方程。

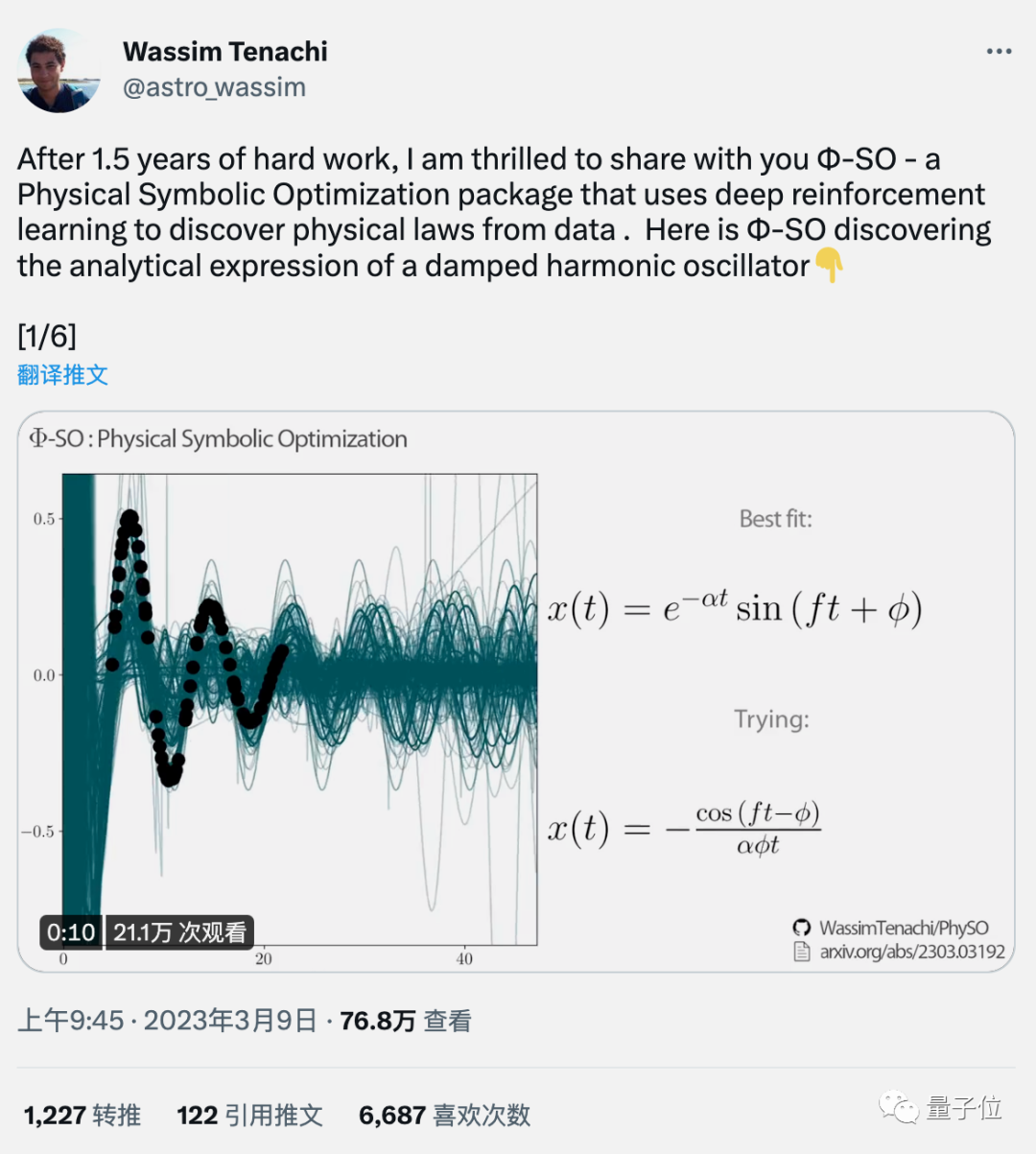

这项成果来自德国斯特拉斯堡大学与澳大利亚联邦科学与工业研究组织Data61部门,据论文一作透露,研究用了1.5年时间,受到学术界广泛关注。

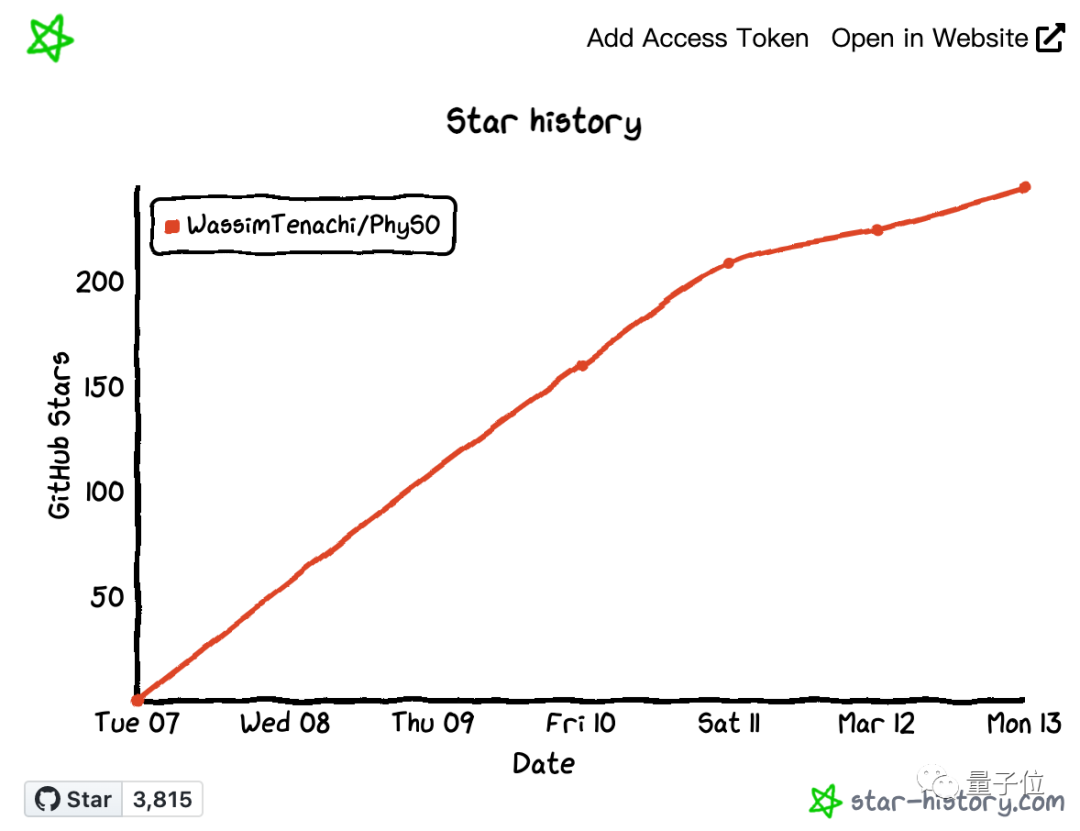

代码一经开源,涨星也是飞快。

除了物理学者直呼Amazing之外,还有其他学科研究者赶来探讨,能不能把同款方法迁移到他们的领域。

强化学习+物理条件约束

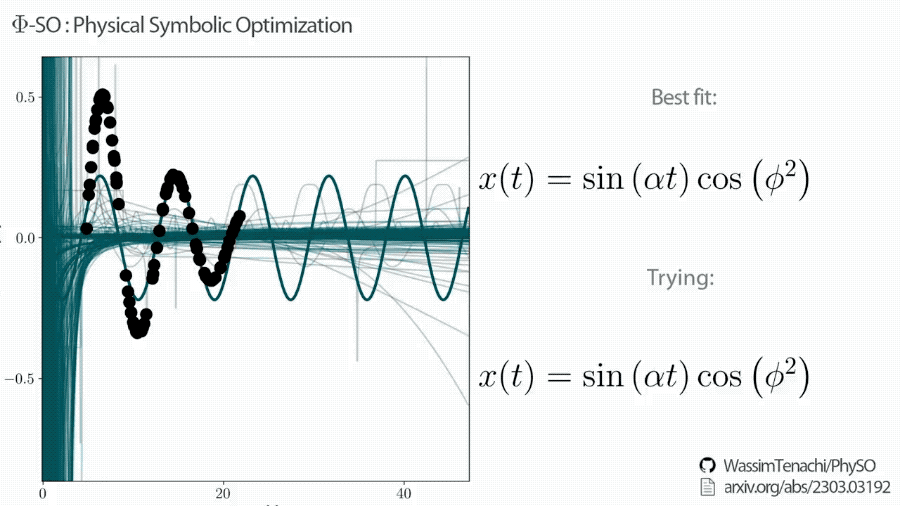

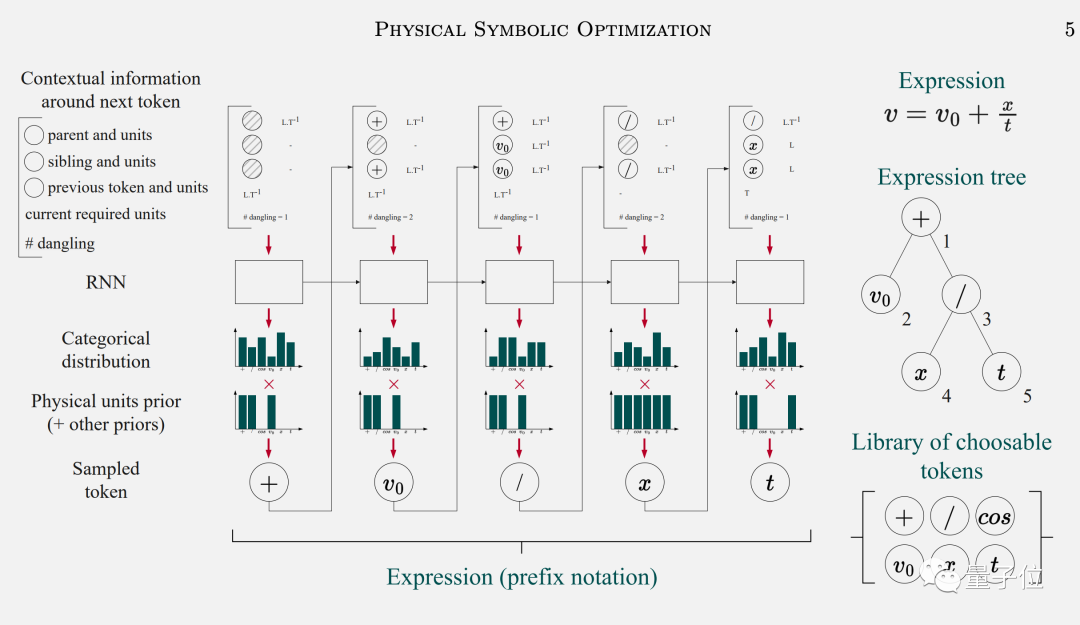

Φ-SO背后的技术被叫做“深度符号回归”,使用循环神经网络(RNN)+强化学习实现。

首先将前一个符号和上下文信息输入给RNN,预测出后一个符号的概率分布,重复此步骤,可以生成出大量表达式。

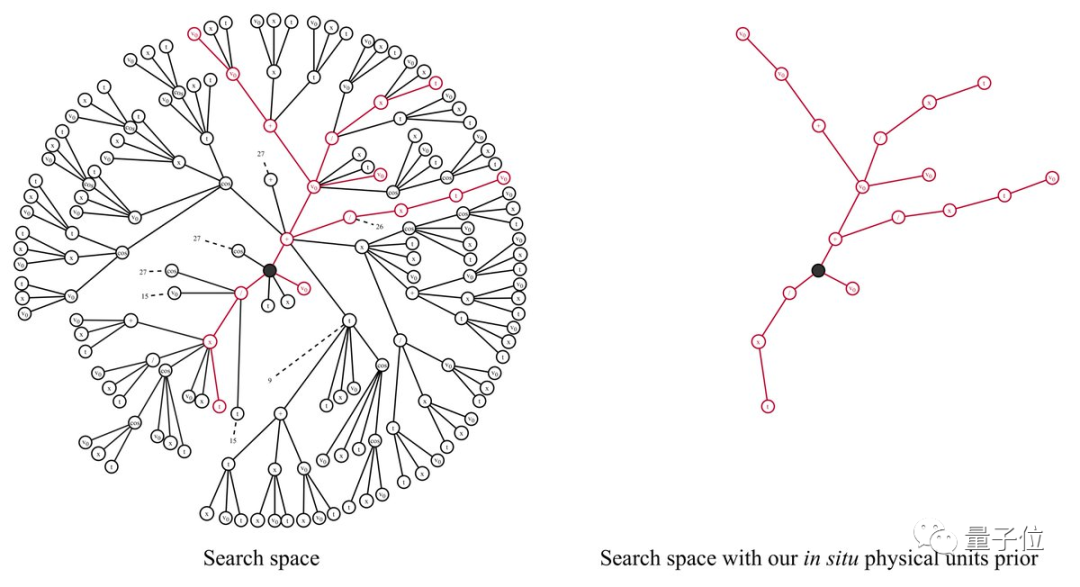

同时将物理条件作为先验知识纳入学习过程中,避免AI搞出没有实际含义的公式,可以大大减少搜索空间。

再引入强化学习,让AI学会生成与原始数据拟合最好的公式。

与强化学习用来下棋、操控机器人等不同,在符号回归任务上只需要关心如何找到最佳的那个公式,而不关心神经网络的平均表现。

于是强化学习的规则被设计成,只对找出前5%的候选公式做奖励,找出另外95%也不做惩罚,鼓励模型充分探索搜索空间。

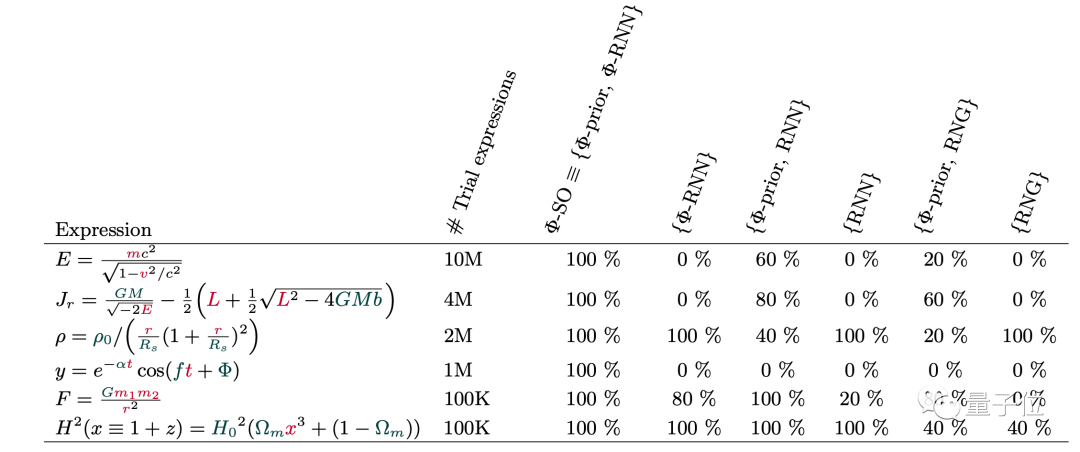

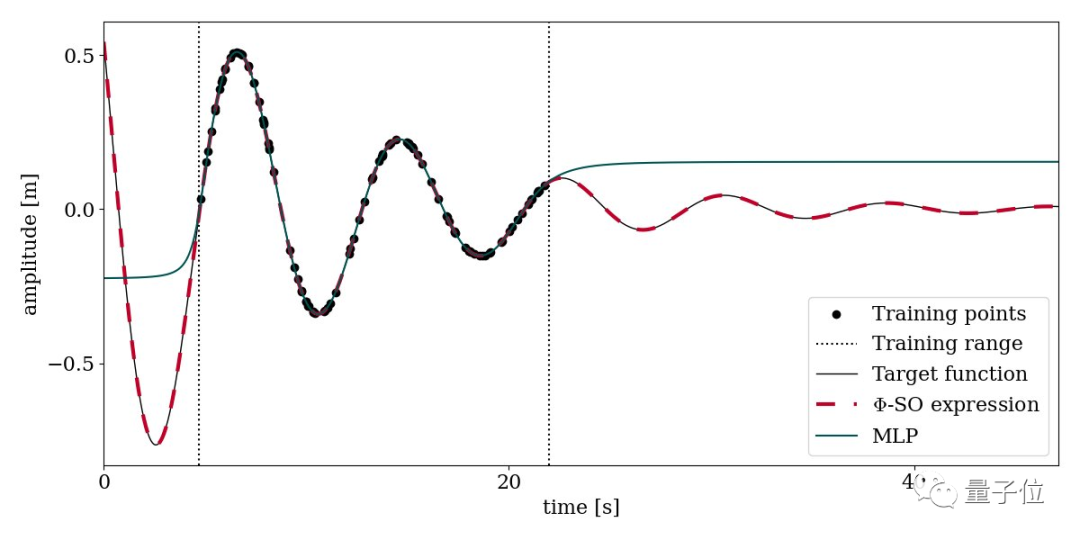

研究团队用阻尼谐振子解析表达式、爱因斯坦能量公式,牛顿的万有引力公式等经典公式来做实验。

Φ-SO都能100%的从数据中还原这些公式,并且以上方法缺一不可。

与其他方法入MLP相比,Φ-SO在训练范围之外的表现也要更好。

研究团队在最后表示,虽然算法本身还有一定改进空间,不过他们的首要任务已经改成用新工具去发现未知的物理规律去了。

GitHub:

https://github.com/WassimTenachi/PhySO

论文:

https://arxiv.org/abs/2303.03192

参考链接:

[1]https://twitter.com/astro_wassim/status/1633645134934949888